Introdução

A transformação digital avançou a um ponto em que a inteligência artificial (IA) deixou de ser apenas um recurso experimental e passou a ser o motor central de inovação em empresas de todos os setores. Modelos de machine learning e IA generativa já estão presentes em sistemas críticos de atendimento, saúde, finanças, supply chain e até em tomadas de decisão estratégicas.

Mas essa revolução traz um desafio central: como garantir a escalabilidade em APIs de inteligência artificial? Afinal, sem uma camada robusta de integração, modelos de IA ficam restritos a ambientes laboratoriais, incapazes de operar em larga escala.

É nesse contexto que plataformas de integração, como a MuleSoft, desempenham papel fundamental. Ao lado de parceiros estratégicos como a Nova IT — empresa com quase 20 anos de experiência em integrações complexas —, torna-se possível levar soluções de IA para dentro de ambientes corporativos exigentes, com governança, performance e segurança.

O desafio da escalabilidade em APIs de IA

A escalabilidade é um dos maiores gargalos quando se trata de consumir IA via APIs. Isso acontece porque os modelos de inteligência artificial, especialmente os LLMs (Large Language Models) e os multimodais, demandam grande capacidade computacional.

Principais desafios técnicos:

- Alto volume de requisições concorrentes: empresas globais podem realizar milhões de chamadas de API por hora.

- Latência: a inferência de modelos complexos pode levar segundos, enquanto aplicações de negócio exigem respostas em milissegundos.

- Custos de GPU: cada requisição de inferência consome recursos caros. Escalar sem controle significa estourar orçamentos rapidamente.

- Versionamento de modelos: APIs precisam suportar diferentes versões de modelos em produção, sem interromper fluxos críticos.

- Workloads distintos: batch (treinamentos e análises de grandes volumes) e real time (chatbots, predições em sistemas de atendimento) exigem arquiteturas diferentes.

Esses pontos tornam evidente que a escalabilidade em APIs de inteligência artificial é um desafio arquitetural e estratégico.

Arquitetura para escalabilidade em APIs de inteligência artificial

Garantir que uma API de IA funcione de forma escalável exige a combinação de padrões de arquitetura, boas práticas de engenharia e plataformas especializadas em integração.

APIs síncronas vs assíncronas

- Síncronas (REST/gRPC): adequadas para inferências rápidas (ex.: recomendação em e-commerce).

- Assíncronas (eventos/webhooks): ideais para workloads de processamento pesado (ex.: análise de imagens médicas).

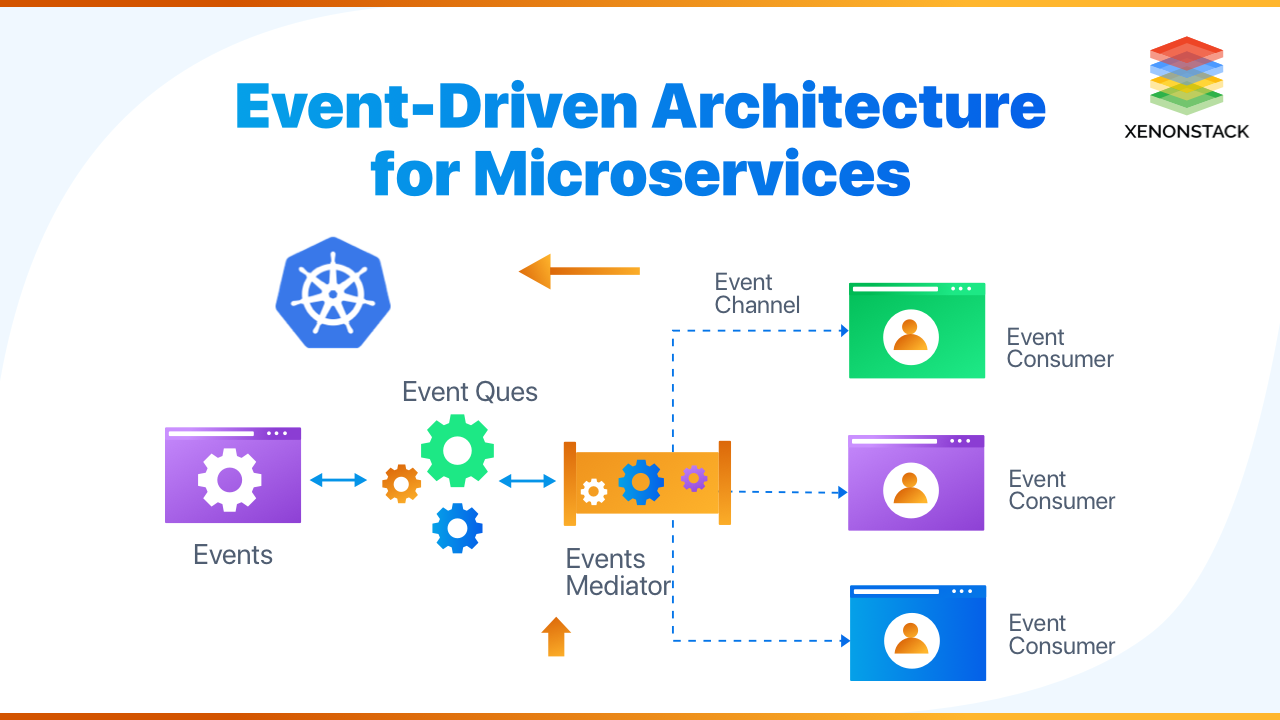

Microsserviços e containers

- Microsserviços desacoplados permitem que cada modelo seja exposto e escalado independentemente.

- Containers em Kubernetes com autoscaling ajustam a infraestrutura conforme a demanda.

API Gateway como camada crítica

- Centraliza autenticação, segurança e monitoramento.

- Implementa políticas de rate limiting e caching.

- Direciona tráfego para versões diferentes de modelos em produção.

Padrões de escalabilidade

- Horizontal scaling: adicionar mais instâncias para dividir carga.

- Vertical scaling: aumentar capacidade de cada nó.

- Normalmente, IA exige horizontal scaling para lidar com volume massivo.

Observabilidade integrada

- Tracing distribuído (OpenTelemetry).

- Métricas de latência, erros e throughput em tempo real.

- Dashboards com Prometheus + Grafana para monitorar saúde da API.

Governança e segurança em APIs de IA

A escalabilidade em APIs de inteligência artificial não é apenas técnica: envolve governança e segurança para que os fluxos sejam confiáveis.

Autenticação e autorização

- OAuth2, JWT e mTLS garantem segurança no consumo.

- Controle de escopo de uso por aplicação ou desenvolvedor.

Rate limiting e throttling

- Essenciais para evitar abusos em APIs expostas.

- Definem limites de requisição por usuário ou app.

Data privacy e compliance

- Leis como LGPD, GDPR e HIPAA exigem governança sobre dados processados por IA.

- APIs precisam aplicar anonimização e mascaramento de dados sensíveis.

Observabilidade e auditoria

- Logs detalhados para auditoria de uso.

- Métricas de consumo vinculadas a billing (custos por requisição).

A governança é fundamental não apenas para escalar, mas para garantir que a IA opere de forma segura, auditável e ética.

MuleSoft como aceleradora de escalabilidade

A MuleSoft, principal parceira da Nova IT, é hoje a plataforma líder para integração de sistemas via APIs. No contexto da IA, ela se torna ainda mais relevante porque permite expor, gerenciar e escalar APIs de inteligência artificial de forma centralizada.

Como a MuleSoft ajuda:

- Anypoint Platform como hub central de APIs.

- API Manager para versionamento, políticas de segurança e rate limiting.

- Design Center para documentação clara e consumo rápido por desenvolvedores.

- DataWeave para transformação de dados, ajustando payloads de entrada/saída dos modelos de IA.

- Orquestração de sistemas enterprise: conectar IA a SAP, Salesforce, Oracle, Totvs, entre outros.

Na prática, a MuleSoft resolve o grande desafio da escalabilidade: padroniza e governa o consumo de IA em múltiplos sistemas corporativos.

Casos práticos de escalabilidade em APIs de IA com MuleSoft

Exemplo 1: NLP em tempo real com load balancing

Um chatbot corporativo conectado a um modelo de NLP precisa lidar com milhares de usuários simultâneos. Com MuleSoft, é possível:

- Configurar políticas de load balancing.

- Monitorar latência em tempo real.

- Escalar horizontalmente instâncias do modelo conforme picos de uso.

Exemplo 2: Integração de LLMs com CRM via MuleSoft

Empresas podem expor uma API de LLM integrada ao Salesforce para enriquecer dados de clientes.

- MuleSoft gerencia a autenticação e limita consumo por usuário.

- Garante governança sobre dados sensíveis de clientes (LGPD).

- Possibilita orquestrar workflows complexos (ex.: criar tickets, gerar recomendações).

Exemplo 3: Supply chain com eventos em tempo real

Modelos de IA podem prever rupturas de estoque. Via MuleSoft:

- APIs expõem insights do modelo de IA.

- Webhooks notificam sistemas de supply chain em tempo real.

- Governança centralizada garante confiabilidade em ambientes críticos.

Esses exemplos mostram como a escalabilidade em APIs de inteligência artificial só é viável em produção quando plataformas como MuleSoft garantem orquestração, segurança e performance.

Melhores práticas para APIs escaláveis de IA

1. Design-first com OpenAPI/Swagger

Defina contratos antes de implementar, garantindo clareza e padronização.

2. Escolha do protocolo certo

- REST para simplicidade.

- GraphQL para consultas customizadas.

- gRPC para baixa latência em cenários críticos.

3. Resiliência e tolerância a falhas

- Circuit breaker para falhas em modelos de IA.

- Retries automáticos com backoff exponencial.

4. Observabilidade nativa

- Logs estruturados e tracing distribuído.

- KPIs de performance: p95 de latência, erros por segundo, throughput.

5. Testes de carga contínuos

Ferramentas como Locust ou JMeter validam a escalabilidade em cenários de pico.

6. Versionamento de modelos e APIs

Mantenha versões estáveis (v1, v2) para evitar interrupções em clientes que ainda não migraram.

Conclusão

A escalabilidade em APIs de inteligência artificial é um pré-requisito para que a IA realmente transforme empresas. Modelos robustos perdem valor se não puderem ser consumidos em larga escala, com governança e performance.

Plataformas como a MuleSoft cumprem papel estratégico nesse cenário, permitindo que empresas exponham e escalem suas APIs de IA com segurança, observabilidade e integração profunda aos sistemas corporativos.

Na Nova IT, esse é um dos focos principais: criar arquiteturas de APIs para IA que unam inovação, escalabilidade e governança. Com quase 20 anos de experiência em integrações complexas e como parceira oficial MuleSoft, a empresa está preparada para ajudar organizações a não apenas adotar IA, mas a operar IA em escala corporativa.

O futuro da tecnologia depende de como conseguimos escalar inteligência artificial via APIs. E esse futuro já está sendo construído agora.